Facebook’un kendi veri merkezi var mı

Facebook’un kendi veri merkezleri var mı?

Özet:

Meta (eski adıyla Facebook) şu anda yapım aşamasında olan 47 veri merkezi var ve yakın gelecekte 70’den fazla binaya sahip olma planları. Bu, şirketin küresel altyapı genişlemesini yansıtıyor ve dünya çapında 18 veri merkezi kampüsü toplam 40 milyon feet kare. Pandemik ve tedarik zinciri kesintilerinin yarattığı zorluklara rağmen, Meta 2022’de 29 milyar ila 34 milyar dolar arasında yatırım yapmayı bekliyor.

Anahtar noktaları:

- Meta’nın yapım aşamasında 47 veri merkezi ve yakın gelecekte 70’den fazla bina planı var.

- Şirketin dünya çapında 18 veri merkezi kampüsü var.

- Pandemik ve tedarik zinciri kesintileri sırasında genişleme zorlayıcı.

- Meta, 2022’de 29 milyar ila 34 milyar dolar arasında yatırım yapmayı bekliyor.

- Meta ve Microsoft gibi hiper ölçekli operatörler, veri merkezi altyapılarını genişletmek için milyarlarca para döküyorlar.

- Facebook tarafından kurulan açık Compute Projesi.

- Veri Merkezi İnşaatı Esnek Site Seçimi ve İnşaat Süreçleri gerektirir.

- Meta, satıcılara ve müteahhitlere en iyi uygulamaları ve sürekli iyileştirmede ortak olarak bakıyor.

- Meta ve diğer hiper ölçekli operatörler, ölçek ve hız sağlamak için yeni stratejilere öncülük ediyor.

- Veri Merkezi Programının Ölçeği ve Mücadelesi Meta için itici bir güçtür.

Sorular:

- Meta’nın veri merkezi inşaatının mevcut durumu nedir?

- Meta’nın dünya çapında kaç veri merkezi kampüsü var?

- Meta veri merkezi genişlemesinde ne gibi zorluklarla karşılaşıyor??

- Meta 2022’de sermaye harcamalarına ne kadar yatırım yapmayı planlıyor??

- Hangi şirketler ayrıca veri merkezi altyapısına yatırım yapıyor?

- Açık hesaplama projesinin rolü nedir?

- Veri merkezi inşaatında hangi faktörler önemlidir?

- Meta satıcıları ve müteahhitleri nasıl görür??

- Meta ve diğer hiper ölçekli operatörler ne gibi stratejiler öncü?

- Meta’nın Veri Merkezi Programını Neyin Yönlendirdiği?

Meta şu anda yapım aşamasında olan 47 veri merkezi var ve yakın gelecekte 70’den fazla bina planı.

Meta’nın dünya çapında 18 veri merkezi kampüsü var.

Pandemik ve tedarik zinciri kesintileri sırasında veri merkezi genişlemesi meta için zorluklar yaratıyor.

Meta, 2022’de 29 milyar ila 34 milyar dolar arasında yatırım yapmayı bekliyor.

Microsoft gibi hiper ölçekli operatörler de veri merkezi altyapılarını genişletmek için milyarlarca yatırım yapıyorlar.

Facebook tarafından kurulan açık hesaplama projesi, yeniliği donanımda yönlendiriyor.

Veri Merkezi İnşaatı Esnek Site Seçimi ve İnşaat Süreçleri gerektirir.

Meta, satıcıları ve yüklenicileri en iyi uygulamaları ve sürekli iyileştirmede ortak olarak görüyor.

Meta ve diğer hiper ölçekli operatörler, ölçek ve hız sağlamak için yeni stratejilere öncülük ediyor.

Veri Merkezi Programının Ölçeği ve Mücadelesi Meta için itici bir güçtür.

Facebook’un kendi veri merkezi var mı

Facebook başka ne çıkarıyor? Frankovsky, “Bugün birçok anakartı birçok yönetim Goop ile geliyor. Bunun için kullanmayı sevdiğim teknik terim.”Bu Goop, HP’nin entegre yaşam döngüsü yönetim motoru veya Dell’in uzak sunucu yönetimi araçları olabilir.

Facebook’un yapım aşamasında 47 veri merkezi var

Meta şu anda yapım aşamasında olan 47 veri merkezi var, şirket bu hafta, dünyanın devam eden genişlemesinin olağanüstü kapsamını yansıtan’S Dijital Altyapı.

BT’S kısa bir açıklama, Facebook’ta inovasyonun uzun bir incelemesinin derinliklerinde’S Dijital Altyapı. Ancak veri merkezi endüstrisini bilen herkes için’S gerçek bir göz açıcı.

“Ben’Bunu yazarken, yapım aşamasında 48 aktif bina ve 47 bina daha var,” Said Tom Furlong, Altyapı Başkanı, Meta’daki Veri Merkezleri (eski Facebook). “Yani biz’Yakın gelecekte 70’den fazla binaya sahip olacak.”

İfade, meta’nın olağanüstü kapsamını yansıtıyor’s küresel altyapı genişlemesi. Şirketin, tamamlandıktan sonra 40 milyon metrekarelik veri merkezi alanını kapsayacak 18 veri merkezi kampüsü var.

Yapım aşamasında 47 binaya sahip olmak her koşulda zor olacaktır, ancak özellikle küresel bir pandemik ve tedarik zinciri bozulması sırasında. BT’S kolay veya ucuz değil. Meta, geçen yıl 19 milyar dolardan 2022’de 29 milyar ila 34 milyar dolar arasında sermaye harcamalarına yatırım yapmayı beklediğini söylüyor.

BT’Yalnız değil, en büyük hiper ölçekli operatörler, dijital hizmetlerine olan talebi karşılamak için veri merkezi altyapılarını genişletmeye milyarlarca dolar döküyorlar. Altı aylık dönemde yaklaşık 83 milyar dolar harcayan 19 hiper ölçekli sağlayıcı izleyen Synergy Research Group’un bir analizine göre, 2021’in ilk yarısında hipers ölçekli sermaye harcamaları yüzde 30 arttı.

Facebook ışığında bu harcama seviyeleri kolayca artabilir’Gelecekteki Capex Harcamaları ve Microsoft ile ilgili projeksiyonlar’s yılda 50 ila 100 veri merkezi inşa etmeyi planlıyor.

Epic ölçekte altyapı inovasyonu

Küstah’M Meta hakkında blog yazısı’S Veri Merkezi Yolculuğu, Facebook tarafından 2011 yılında kurulan Açık Donanım Girişimi Open Compute Project’in ilerlemesine bakan eşlik eden bir yazı gibi okumaya değer.

“Open Donanım Yenilikleri Tahrikleştirir ve daha fazla satıcı ile çalışmak, Meta’da mevcut ve gelişmekte olan özellikleri desteklemek için yeni nesil donanım geliştirmek için daha fazla fırsat anlamına gelir’s teknoloji ailesi.,” Furlong yazıyor.

Ölçekte yenilik yapma ihtiyacı, veri merkezi inşaatı da dahildir.

“Veri merkezi ve inşaat endüstrilerinde bugün doğru siteleri ve ortakları bulmamıza baskı yapan çok fazla faaliyet var,” dedi furlong. “Ayrıca, daha esnek site seçimi ve inşaat süreçleri oluşturmamız gerektiği anlamına gelir. Tüm bu çaba aynı zamanda satıcılarımıza ve yüklenicilerimize daha çok ortak olarak bakmayı içerir. Yapabiliriz’T sadece dolar hakkında yap. Performans hakkında bunu yapmalıyız. En iyi uygulamaları ve sürekli iyileştirme konusunda bunu yapmalıyız.

“Ama bu’İnşaat endüstrisinin tipik olarak çalışma şekli değil,” o devam etti. “Yani biz’Operasyonlar yürütme ve iyileştirmeler yapma ve birlikte çalıştığımız şirketler üzerinde etkilemek için kendi fikrimizin çoğunu getirmek zorunda kaldı.”

Dijital altyapı her gün daha önemli hale geliyor ve Meta ve hiper ölçekli meslektaşları, ihtiyaç duydukları ölçeği ve hızı sağlamak için yeni stratejilere öncülük ediyor. BT’Furlong’un yansıttığı gibi devam eden bir süreç.

“Veri Merkezi Arena’ya taşınma asla kolay olmayacak,” O yazıyor. “Ama bence biz’ve asla hayal edemeyeceğim bir ölçekte inanılmaz bir programla sona erdi. Ve biz’her zaman daha fazlasını yapması istenir. O’iş meydan okuması ve bu’Muhtemelen beni ve ekibimin her gün işe gelmesini sağlayan ana şeylerden biri. Önümüzde bu muazzam bir zorluk var, ölçekte inanılmaz derecede büyük bir şey yapmak.”

Facebook’un kendi veri merkezi var mı

Blog Home’a geri dön

20 2016

Facebook Altyapısı: İç Veri Merkezi Stratejisi ve Geliştirme

Meta kariyerlerine göre

Rachel Peterson, Facebook’un Altyapı Veri Merkezi Strateji Ekibine liderlik ediyor. Ekibi Facebook’un Veri Merkezi portföyünü yönetiyor ve daha fazla altyapı sürdürülebilirliği, verimlilik ve güvenilirlik fırsatlarını belirlemek için stratejik destek sağlıyor. Facebook’taki deneyimine ve ekibinin dünyayı nasıl bağlamaya çalıştığını bir inceleyin.

Facebook hikayen nedir?

Facebook’a 2009 yılında şirketin ilk veri merkezini Prineville, Oregon’da başlatmak üzere olduğu zamana katıldım. O zaman, Veri Merkezi ekibinin tamamı 30’dan az ekip üyesinden oluşuyordu ve Facebook ABD’de iki küçük ortak ayak izini işgal etti. Facebook’un sahip olunan veri merkezleri için site seçim programını oluşturmaya yardımcı olmak için katıldım. Bugün ekibimiz, dünyanın dört bir yanındaki birçok yerde 100’den fazla kişiden oluşuyor.

Bugüne kadar, Facebook artık ABD, Avrupa ve Asya’yı kapsayan büyük bir veri merkezi portföyüne sahip ve işletiyor. Site Seçim Programı, on beş büyük veri merkezi başarıyla başlattı ve bu veri merkezlerine% 100 yenilenebilir enerji ile güç vermeye kararlıyız. 2012 yılında, 2015 yılında tüm veri merkezleri için elektrik tedarik karışımımızda% 25 temiz ve yenilenebilir enerji hedefimizi belirledik. 2017 yılında, Facebook’un tüm operasyonları için% 50 temiz ve yenilenebilir enerjiyi aştık. 2018’de bir sonraki agresif hedefimizi belirledik – 2020’nin sonuna kadar tüm Facebook’un büyüyen operasyonları için% 100 temiz ve yenilenebilir enerjiyi karşılamayı hedefledik.

Bu büyümenin ön saflarında olmak ve Facebook’un altyapısını büyütmede kritik bir rol oynayan takımı inşa etmek gerçekten heyecan verici oldu. Bu muhteşem yolculukta hiç sıkıcı bir an olmadı! Facebook’un büyümesi onu hem zorlu hem de eğlenceli hale getirdi ve bir günün öğrendiğim yerden geçtiğini sanmıyorum. Yaptığım şeyi seviyorum ve bu kadar şaşırtıcı, eğlenceli bir takımla çalışmak için gerçekten şanslıyım. Facebook’un kültürü ekibime geniş kapsamlı bir etkiye sahip olmasını sağlıyor ve birlikte dünyayı daha açık ve bağlantılı hale getiriyoruz. Her seferinde bir veri merkezi.

Facebook’un misyonu dünyayı daha açık ve bağlantılı hale getirmektir, ekibinizin bu konuda rolü vardır?

Facebook’un küresel konum stratejisini ve site seçim çabalarını, siteleri desteklemek için yeni yenilenebilir enerji de dahil olmak üzere bir dizi kritik oturma kriterine dayanan yönlendiriyor.

Hava ve Su Uyumluluğu dahil operasyonlar boyunca site seçiminden Facebook’un küresel çevre uyum programlarını yönetir.

Facebook’un küresel enerji programlarını, operasyonlar boyunca site seçiminden,% 100 yenilenebilir enerji için enerji arzını optimize ederken, mali sorumluluk ve güvenilirliği sağlar.

Global Veri Merkezi Yol Haritası’nın stratejik planlaması, sağlanması ve izlenmesine öncülük eder.

Veri merkezi yaşam döngüsünde stratejik kararlar ve performans optimizasyonu sağlamak için veri bilimi desteği sağlar.

Veri Merkezlerimizin bulunduğu yerlerde topluluk katılım çalışmalarımızı yönlendirir.

Facebook’un küresel genişlemesine izin vermek için politika ve risk azaltma stratejilerini geliştirir ve yönetir’S altyapı ayak izi.

Facebook, iş sağlayarak, ekonomiyi büyüterek ve içinde yaşadığımız topluluklara fayda sağlayan programları destekleyerek her yerde iyi bir güç olmaya kararlıdır.

Sürdürülebilirlik Ekibimiz’S misyonu Facebook’u desteklemektir’S sürdürülebilir topluluklar kurma ve insanları sürdürülebilir topluluklar kurma konusunda güçlendirme ve büyüme yeteneği.

İşletmemizin tasarım, inşaatı ve işleyişinden operasyonel mükemmelliği artırmada şirket çapında stratejiye öncülük ediyor. Verimliliğe, su tasarrufuna ve tedarik zinciri mükemmelliğine öncelik veriyoruz ve tesislerimizin dünyadaki en fazla su ve enerji verimli olduğunu söylemekten gurur duyuyoruz.

İklim değişikliğiyle mücadele etmeye kararlıyız ve 2020 yılına kadar emisyonlarımızı yüzde 75 azaltmak için bilime dayalı bir hedef belirledik.

Facebook’un temel değerleri hızlı hareket eder, etkiye odaklanır, sosyal değer oluşturur, açık olun, cesur olun. Takımınızla hangi değer gerçekten yankılanıyor?

Etkiye odaklanın. Ekibimiz nispeten yalındır ve yine de şirket için birçok yüksek etkili girişim sunma yeteneğine sahibiz.

Çoğu insanın ekibiniz hakkında bilmediği bir şey nedir?

Avukatlar, kamu politikası yöneticileri, finansal analistler, program yöneticileri, veri bilimcileri, enerji profesyonelleri, mühendisler ve iş süreci uzmanlarından oluşan çok çeşitli bir ekibimiz var.

Teknoloji endüstrisinde kadın lider olmayı ve Facebook’ta ve genel olarak teknolojide çeşitliliğin önemini paylaşabilir misiniz??

Facebook’ta çalışmayı sevmemin nedenlerinden biri, çeşitliliğe olan bağlılığımızdır. Çeşitlilik Facebook’ta ders dışı bir etkinlik değil, şirketin tüm seviyelerinde uygulamayı hedeflediğimiz bir şeydir. Biz ve bir bütün olarak teknoloji endüstrisi burada daha fazla işimiz olsa da, bu taahhüdü kültürümüz, ürünlerimiz ve işe alım önceliklerimiz aracılığıyla sürekli olarak güçlendiriyoruz.

Teknolojideki bir kadın olarak, çeşitliliğin sektörümüz için ne kadar önemli olduğunu ve ne kadar çeşitli perspektiflerin daha iyi sonuçlar verdiğini ilk elden biliyorum. Farklı adayların işe alınmasını geliştirmek ve kadınları tipik olarak erkek egemen olan sektörlere katılmaya teşvik etmek için elimizden gelen her şeyi yapmamız önemlidir. Kariyerimi, geleneksel olarak erkek egemen bir endüstri olan gayrimenkul sitesi seçiminde buldum ve ilhamımı yol boyunca ilham veren ve mentorluk yapan birçok yetenekli kadın aracılığıyla buldum. Bugün, teknolojide bir kadın lideri olarak, kadınlara akıl hocası olmak ve bu sektördeki kadınların büyümesini ve ilerlemesini aktif olarak desteklemek için elimden geleni yapmak benim görevim ve ayrıcalığımdır.

Kadınlar için tavsiyem? Tutkularınızı bulun ve onları takip edin, sonunda bir bölgede olsanız bile’normalde odadaki tek kadın. Güçlü yönleriniz tutkularınız aracılığıyla gelişecek ve siz’zanaatınızda daha çok çalışacak. Kariyerin kendi yörüngesini bulacak. En önemlisi, başarısız olmasına izin verin ve yol boyunca tökezlerseniz hemen geri dönün.

Facebook’un kendi veri merkezi var mı

Facebook’S Hizmetleri, dünyanın her yerindeki veri merkezlerindeki sunucu filolarına güvenir – tüm çalışan uygulamalar ve hizmetlerimizin ihtiyaç duyduğu performansı sunar. Bu nedenle, sunucu donanımımızın güvenilir olduğundan ve sunucu donanım hatalarını ölçeğimizde mümkün olduğunca az kesintiye uğratarak yönetebilmemiz gerekir.

Donanım bileşenlerinin kendileri, malzeme bozulması dahil olmak üzere herhangi bir nedenden dolayı başarısız olabilir (e.G., bir dönen sabit disk sürücüsünün mekanik bileşenleri), dayanıklılık seviyesinin ötesinde kullanılan bir cihaz (e.G., Nand Flash Cihazlar), Çevresel Etkiler (E.G., nem nedeniyle korozyon) ve üretim kusurları.

Genel olarak, veri merkezlerimizde her zaman bir dereceye kadar donanım hatası bekliyoruz, bu yüzden hizmet kesintilerini en aza indirmek için küme yönetim sistemimiz gibi sistemleri uyguluyoruz. Bu makalede biz’Yüksek derecede donanım mevcudiyetini korumamıza yardımcı olan dört önemli metodolojinin yeniden sunulması. Sorunları tespit edebilen ve düzeltebilen sistemler inşa ettik . Uygulama performansını olumsuz etkilemeden donanım olaylarını izliyoruz ve düzeltiyoruz . Donanım onarımları için proaktif yaklaşımlar benimsiyoruz ve iyileştirmeler için tahmin metodolojisini kullanıyoruz . Ve sorunların altına hızlı bir şekilde ulaşmak için ölçekli donanım ve sistem arızaları için kök neden analizini otomatikleştiriyoruz.

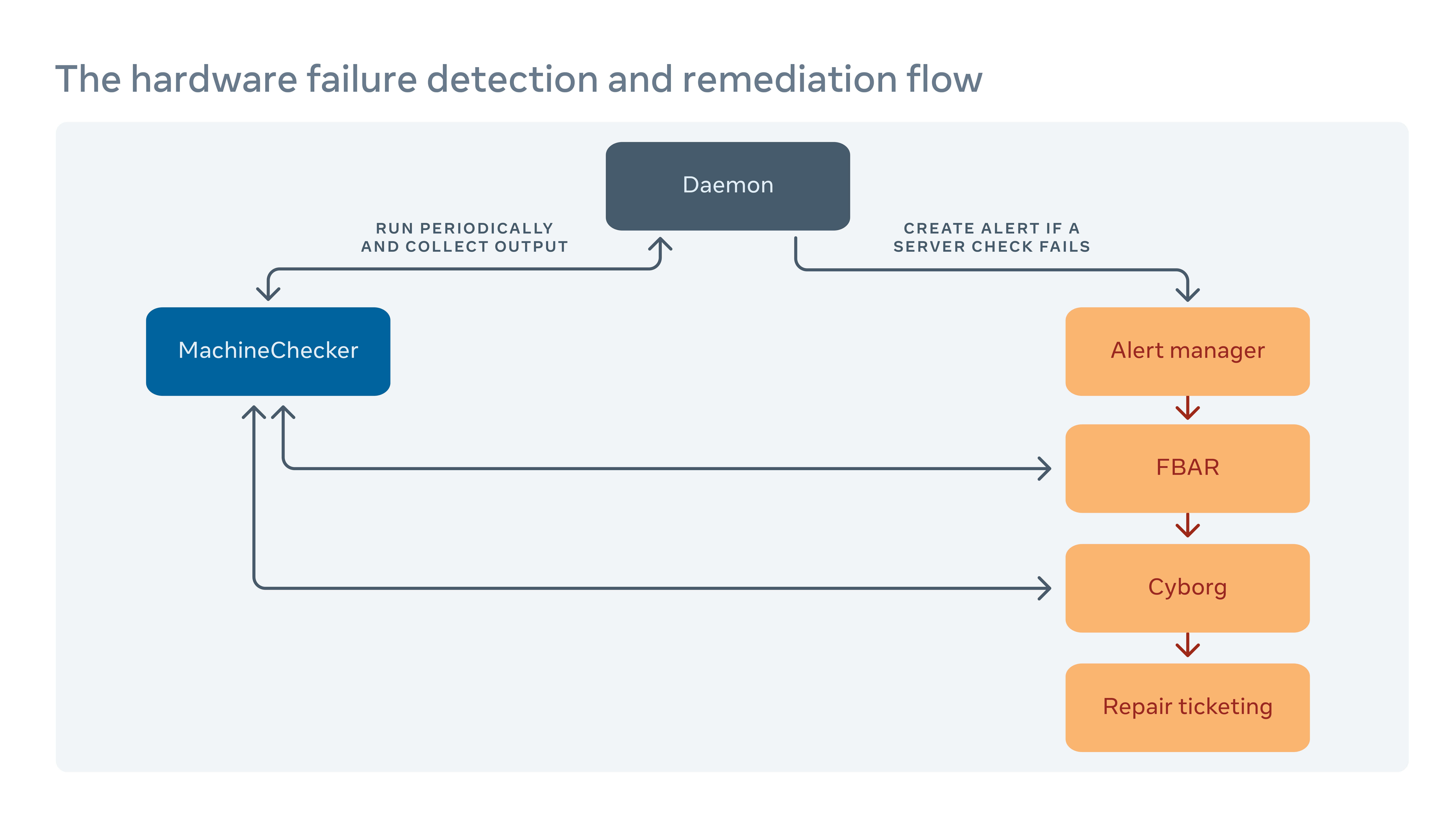

Donanım iyileştirmesini nasıl ele alıyoruz

Donanım ve bağlantı arızalarını algılamak için periyodik olarak her sunucuda machinechecker adlı bir araç çalıştırırız. Machinechecker, merkezi bir uyarı işleme sisteminde bir uyarı oluşturduğunda, Facebook Otomatik Yeniden İlişkilendirme (FBAR) adlı bir araç daha sonra uyarıyı alır ve hatayı düzeltmek için özelleştirilebilir iyileştirmeler yürütür. Orada olmasını sağlamak için’Facebook için hala yeterli kapasite’S hizmetleri, herhangi bir zamanda kaç sunucunun onarıldığını kısıtlamak için oran sınırları da belirleyebiliriz.

FBAR yapabilirse’t Sunucuyu sağlıklı bir duruma geri getirin, arıza Cyborg adlı bir araca iletilir. Cyborg, ürün yazılımı veya çekirdek yükseltmeleri gibi daha düşük seviyeli iyileştirmeler ve yeniden görüntüleme yapabilir. Sorun bir teknisyenden manuel onarım gerektiriyorsa, sistem onarım biletleme sistemimizde bir bilet oluşturur.

Makalemizdeki bu süreci daha derinlemesine inceliyoruz “Ölçekte donanım iyileştirmesi.”

Hata raporlamasının sunucu performansı üzerindeki olumsuz etkisini nasıl en aza indiriyoruz

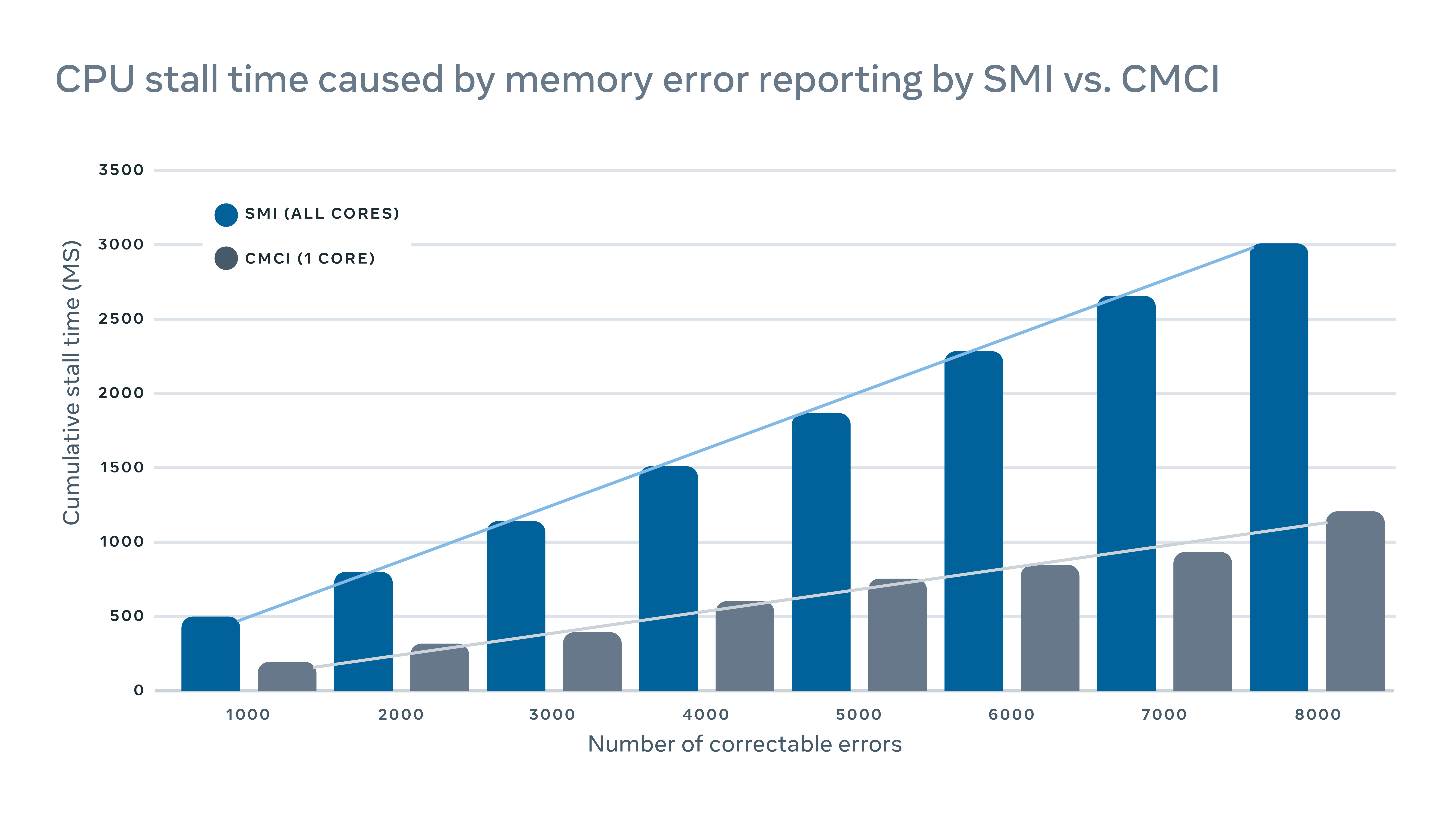

Machinechecker, hata raporları için çeşitli sunucu günlüklerini kontrol ederek donanım arızalarını algılar. Tipik olarak, bir donanım hatası oluştuğunda, sistem tarafından algılanacaktır (e.G., bir parite kontrolü başarısız olmak) ve hatayı işlemek ve kaydetmek için CPU’ya bir kesinti sinyali gönderilir.

Bu kesinti sinyalleri yüksek öncelikli sinyaller olarak kabul edildiğinden, CPU normal çalışmasını durduracak ve dikkatini hatayı ele almaya ayıracaktır. Ancak bunun sunucu üzerinde olumsuz bir performans etkisi var. Örneğin, düzeltilebilir bellek hatalarını kaydetme için, geleneksel bir kesinti sistem yönetimi kesintisi (SMI) tüm CPU çekirdeklerini durdururken, düzeltilebilir makine kontrolü kesmesi (CMCI), CPU çekirdeklerinden sadece birini durdurur ve normal çalışma için mevcut CPU çekirdeklerinin geri kalanını bırakır.

CPU tezgahları tipik olarak sadece birkaç yüz milisaniye sürse de, yine de gecikmeye duyarlı hizmetleri bozabilirler. Ölçekte, bu, birkaç makinedeki kesintilerin hizmet düzeyindeki performans üzerinde basamaklı bir olumsuz etkiye sahip olabileceği anlamına gelir.

Hata raporlamasının neden olduğu performans etkisini en aza indirmek için, düzeltilebilir bellek hatalarının sayısı açısından doğruluğu kaybetmeden hem CMCI hem de SMI kullanan bellek hatası raporlaması için hibrit bir mekanizma uyguladık.

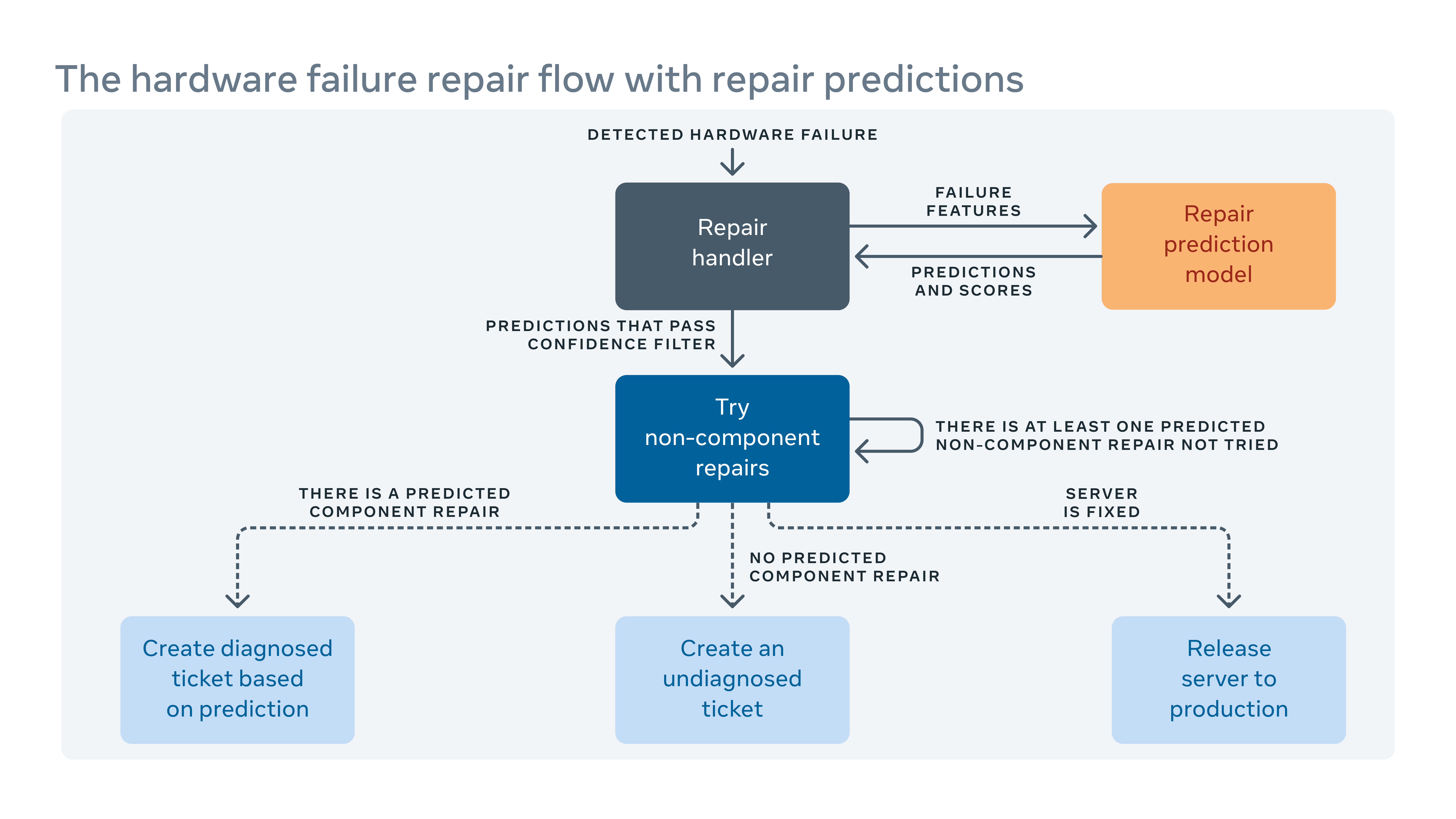

Onarımları tahmin etmek için makine öğreniminden nasıl yararlanıyoruz

Veri merkezlerimize sık sık yeni donanım ve yazılım yapılandırmalarını tanıttığımız için, otomatik eğitim sistemimiz için yeni kurallar oluşturmamız gerekiyor.

Otomatik sistem bir donanım arızasını düzeltemediğinde, soruna manuel onarım için bir bilet verilir. Yeni donanım ve yazılım, ele alınması gereken yeni potansiyel arıza türleri anlamına gelir. Ancak yeni donanım veya yazılım uygulandığında ve yeni iyileştirme kurallarını dahil edebildiğimiz zaman arasında bir boşluk olabilir. Bu boşluk sırasında, bazı onarım biletleri “tanı konmamış,” yani sistem yok’t bir onarım eylemi önerdi veya “yanlış teşhis edildi,” Önerilen onarım eylemi anlamına geliyor’T etkili. Bu, teknisyenler sorunu kendileri teşhis etmek zorundadır.

Boşluğu kapatmak için, geçmişte başarısızlıkların nasıl düzeltildiğini öğrenen ve mevcut tanı konulmamış ve yanlış teşhis edilen onarım biletleri için hangi onarımların gerekli olacağını tahmin etmeye çalışan bir makine öğrenimi çerçevesi oluşturduk. Yanlış ve doğru tahminlerden maliyete ve faydaya dayanarak, her onarım eylemi için tahmin güvenine bir eşik atarız ve onarım eylemlerinin sırasını optimize ederiz. Örneğin, bazı durumlarda önce bir yeniden başlatma veya ürün yazılımı yükseltmesini denemeyi tercih ederiz çünkü bu tür onarımlar Don’t Herhangi bir fiziksel donanım onarımı gerektirir ve bitirmesi daha az zaman alır, bu nedenle algoritma önce bu tür eylemi önermelidir. Açıkçası, makine öğrenimi sadece teşhis edilmemiş veya yanlış teşhis edilen bir sorunu nasıl onaracağımızı değil, aynı zamanda en önemli olanları da önceliklendirmemize izin verir.

Nasıl biz’VE Otomatik Filo Düzey Kök Neden Analizi

Yeniden başlatma kaydeden sunucu günlüklerine ek olarak, çekirdek panikleri bellekten, vb., Üretim sistemimizde yazılım ve takım günlükleri de var. Ancak tüm bunların ölçeği ve karmaşıklığı’Aralarında korelasyon bulmak için tüm günlükleri birlikte incelemek zor.

Anlaşılması kolay ve eyleme geçirilebilir korelasyonlar bulmak için milyonlarca günlük girişini (her biri potansiyel olarak yüzlerce sütun tarafından tarif edilen) sıralayan ölçeklenebilir bir kök kaynağı analizi (RCA) aracı uyguladık.

Gerçek zamanlı bir bellek içi veritabanı olan SCUBA’yı kullanarak verilerin önleme yapmasıyla, bu RCA çerçevesinde korelasyonlar bulmak için geleneksel bir desen madenciliği algoritmasının ölçeklenebilirliğini önemli ölçüde geliştirdik. Ayrıca, sonucun yorumlanabilirliğini artırmak için bildirilen korelasyonlara bir dizi filtre ekledik. Bu analizörü RCA için donanım bileşen arıza oranı, beklenmedik sunucu yeniden başlatmaları ve yazılım arızaları için Facebook içinde geniş çapta dağıttık.

Kim HP ve Dell’e İhtiyacı Var? Facebook artık tüm kendi sunucularını tasarlıyor

Facebook’un en yeni veri merkezinde herhangi bir OEM sunucusu olmayacak.

Jon Brodkin – 14 Şub 2013 22:35 UTC

Okuyucu Yorumları

Neredeyse iki yıl önce Facebook, açık hesaplama projesi olarak adlandırılan şeyi açıkladı. Fikir, sunucular, depolama ve raflar gibi veri merkezi donanımı için tasarımları paylaşmaktı, böylece şirketler donanım satıcıları tarafından sağlanan dar seçeneklere güvenmek yerine kendi ekipmanlarını oluşturabilirler.

Herkes fayda sağlayabilse de, Facebook özel yapım donanımı kendi veri merkezlerinde dağıtmada öne geçti. Proje şimdi Facebook tarafından konuşlandırılan tüm yeni sunucuların Facebook tarafından tasarlandığı veya başkaları tarafından Facebook’un zorlu özelliklerine tasarlandığı noktaya kadar ilerledi. Özel Gear Today, Facebook veri merkezlerindeki ekipmanın yarısından fazlasını alıyor. Sıradaki Facebook, İsveç’te tamamen kendi tasarımının sunucularıyla dolu 290.000 metrekarelik bir veri merkezi açacak, şirket için bir ilk.

Facebook’taki donanım tasarımı ve tedarik zinciri operasyonlarının başkan yardımcısı Frank Frankovsky, ARS’ye bu hafta bir telefon görüşmesinde “İçinde yüzde 100 açık hesaplama sunucularına sahip olacağımız ilk şey” dedi.

Facebook’un Kuzey Carolina ve Oregon’daki mevcut veri merkezleri gibi, bu yaz Luleå, İsveç’te çevrimiçi olan on binlerce sunucuya sahip olacak. Facebook ayrıca, ABD’deki 11 kolokasyon sitesi de dahil olmak üzere, dünyanın dört bir yanındaki kullanıcıların yakınında bir varlığı korumak için ekipmanlarını kiralanan veri merkezi alanına koyar. Çeşitli faktörler yer seçimine katkıda bulunur: vergiler, mevcut teknik emek, güç kaynağı ve maliyeti ve iklim. Facebook geleneksel klima kullanmıyor, bunun yerine sunucularımızı yeterince serin tutmak için tamamen “dış hava ve benzersiz buharlaştırıcı soğutma sistemine” güveniyor, dedi Frankovsky.

Yapmadığınızı çıkararak para biriktirme’gereksinim

Facebook ölçeğinde, kendi veri merkezlerini korumak bulut servis sağlayıcılarına güvenmekten daha ucuz, kaydetti. Dahası, Facebook’un geleneksel sunucu satıcılarından kaçınması da daha ucuzdur.

Google gibi, Facebook da kendi sunucularını tasarlar ve Tayvan ve Çin’de OED’ler (orijinal tasarım üreticileri) tarafından HP veya Dell gibi OEM’ler (orijinal ekipman üreticileri) tarafından inşa edilmesini sağlar. Facebook, kendi kendini yuvarlayarak, Frankovsky’nin “Gratudious Farklılaşma” dediği şeyi ortadan kaldırıyor, sunucuları benzersiz kılan ancak Facebook’a fayda sağlamayan donanım özellikleri.

Marka logosu olan bir sunucudaki plastik çerçeve kadar basit olabilir, çünkü bu ekstra malzeme hayranları daha çok çalışmaya zorlar. Frankovsky, bir çalışmanın standart bir 1U boyutlu OEM sunucusunu “bu plastik çerçevenin neden olduğu empedanstan hava çekmek için 28 watt fan gücü kullandığını”, oysa eşdeğer açık hesaplama sunucusu bu amaçla sadece üç watt kullandığını söyledi.

Facebook başka ne çıkarıyor? Frankovsky, “Bugün birçok anakartı birçok yönetim Goop ile geliyor. Bunun için kullanmayı sevdiğim teknik terim.”Bu Goop, HP’nin entegre yaşam döngüsü yönetim motoru veya Dell’in uzak sunucu yönetimi araçları olabilir.

Bu özellikler, özellikle bir satıcıda standartlaştırılmışsa, birçok müşteri için iyi olabilir. Ancak Facebook’un boyutuna göre, yalnızca bir satıcıya güvenmek mantıklı değildir, çünkü “bir tasarım hatası filonuzun büyük bir bölümünü aşağı indirebilir veya bir parça kıtlığı, veri merkezlerinize ürün sunma yeteneğinizi hamst eder.”

Facebook’un kendi veri merkezi yönetim araçları var, bu yüzden HP veya Dell’in yaptığı şeyler gereksiz. Bir satıcı ürünü “kendi kullanıcı arayüzleri kümesi, API’lar kümesi ve size ne kadar hızlı döndüğünü ve genel olarak çoğu müşterinin bu şeyleri ölçek görünümünde dağıtan bazı şeylerle birlikte gelir” dedi. “Benim için önemli olmayan bir şekilde farklı. Anakarttaki ekstra enstrümantasyon, sadece bir malzeme perspektifinden satın almak için paraya mal olmakla kalmaz, aynı zamanda operasyonlarda karmaşıklığa neden olur.”

HP ve Dell için Bir Yol: Açık hesaplamaya uyum sağlayın

Bu, Facebook’un HP ve Dell’i sonsuza dek yemin ettiği anlamına gelmez. “Yeni ekipmanlarımızın çoğu ODM’ler tarafından Quanta gibi inşa edilmiştir,” dedi şirket takip sorularımızdan birine e-posta yanıtında. “Tüm ekipmanlarımızı çok kaynaklı yapıyoruz ve eğer bir OEM standartlarımızı oluşturabilir ve yüzde 5 içinde getirebilirse, genellikle bu çok kaynaklı tartışmalardalar.”

HP ve Dell, hesaplama özelliklerini açıklamak için uygun tasarımlar yapmaya başladı ve Facebook, kesimi yapıp yapamayacağını görmek için HP’den bir tane test ettiğini söyledi. Şirket, İsveç’teki yeni veri merkezinin açıldığında herhangi bir OEM sunucusu içermeyeceğini doğruladı.

Facebook, daha düşük maliyetli bir altyapıya sahip olmaktan yüzde 24 finansal tasarruf sağladığını ve kendi eşyalarını oluşturmanın bir sonucu olarak devam eden operasyonel maliyetlerde yüzde 38 tasarruf sağladığını söylüyor. Facebook’un özel olarak tasarlanmış sunucuları, diğer sunuculardan farklı iş yükleri çalıştırmıyor-bunları daha verimli bir şekilde çalıştırıyorlar.

Frankovsky, “Bir HP veya Dell Sunucusu veya Açık Compute Server, hepsi genellikle aynı iş yüklerini çalıştırabilir.” Dedi. “Bu sadece dolar başına watt başına ne kadar iş yapacağınız meselesi.”

Facebook sunucularını sanallaştırmıyor, çünkü yazılımı zaten tüm donanım kaynaklarını tüketiyor, yani sanallaştırma verimlilik kazançsız bir performans cezasına neden olacak.

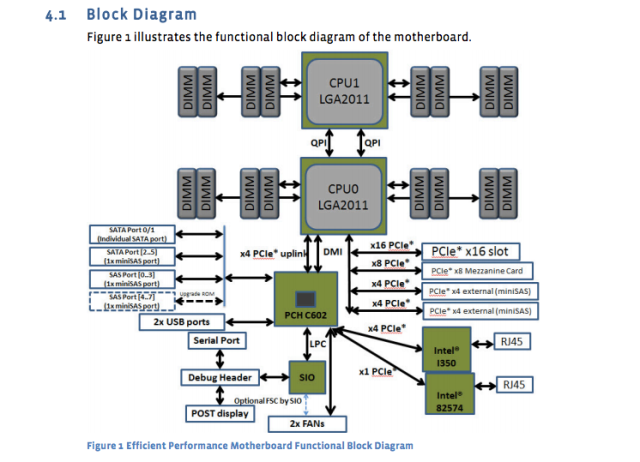

Sosyal medya devi, kendi sunucularının, anakartlarının ve diğer ekipmanlarının tasarımlarını ve özelliklerini yayınladı. Örneğin, “yel değirmeni” anakart, CPU başına sekiz çekirdeğe sahip iki Intel Xeon E5-2600 işlemci kullanıyor.

Facebook’un Spesifik Sayfası Yıkıyor:

- 2 Intel® Xeon® E5-2600 (LGA2011) 115W’ye Kadar Seri İşlemciler

- 2 tam genişlikte Intel QuickPath Connect (QPI) 8 gt/s/yöne bağlantılar

- CPU başına en fazla 8 çekirdeğe kadar (hiper işleyen teknolojiye sahip 16 iş parçacığı)

- Son seviye önbellek 20 MB’a kadar

- Tek işlemci modu

- CPU0 ve CPU1’de DDR3 Doğrudan Ekli Bellek Desteği:

- 4 Kanal DDR3 İşlemciler 0 ve 1’de kayıtlı bellek arayüzü

- İşlemci başına kanal başına 2 DDR3 yuvası (anakartta toplam 16 dimms)

- RDIMM/LV-RDIMM (1.5V/1.35V), LRDIMM ve ECC UDIMM/LV-UDIMM (1.5V/1.35V)

- Tek, ikili ve dörtlü sıralı dimms

- DDR3 Hızları 800/1066/1333/1600 MHz

- 32GB RDIMM DIMMS ile maksimum 512 GB bellek kadar

Ve şimdi anakartın bir diyagramı:

Bu anakart özellikleri neredeyse bir yıl önce yayınlandı, ancak hala standartlar. Yeni tasarlanan veritabanı sunucusu “Dragonstone” ve Web Server “Winterfell” yel değirmen anakartına güveniyor, ancak daha yeni Intel CPU’lar bu yıl Facebook’ta üretime vurabilir.

Facebook’un sunucu tasarımları farklı görevlere göre uyarlanmıştır. Register’ın Timothy Prickett Morgan’ın geçen ay bildirdiği gibi, Facebook’taki bazı veritabanı işlevleri gereksiz güç kaynakları gerektirirken, diğer görevler tek bir güç kaynağı paylaşan birden fazla hesaplama düğümü olan sunucular tarafından işlenebilir.

Veri merkezleri, flash depolama ve geleneksel eğirme disklerinin bir karışımını kullanır ve flash, mevcut en hızlı hızları gerektiren Facebook işlevselliğini sunar. Veritabanı sunucuları tüm flaş kullanıyor. Web sunucuları genellikle nispeten düşük miktarda depolama ve RAM ile gerçekten hızlı CPU’lara sahiptir. 16GB tipik miktarda RAM, dedi Frankovsky. Intel ve AMD Chips’in Facebook Gear’da bir varlığı var.

Ve Facebook birçok “soğuk depolama”, bir kez yazılmış ve nadiren tekrar erişiliyor. Orada bile, Frankovsky, dönen disklerin arıza oranı nedeniyle giderek daha fazla flaş kullanmak istiyor. On binlerce cihaz çalışırken, “teknisyenlerin sabit disklerin yerini almasını istemiyoruz” dedi.

Veri Merkez-Sınıfı Flash genellikle eğirme disklerinden çok daha pahalıdır, ancak Frankovsky buna değer vermenin bir yolu olabileceğini söylüyor. “Tipik olarak süpürme veya hurda NAND olarak kabul edilen başparmak sürücülerinde NAND [Flash] sınıfını kullanırsanız ve hangi hücrelerin iyi olduğunu ve hangi hücrelerin iyi olmadığını karakterize etmek için gerçekten harika bir kontrolör algoritması kullanırsanız, potansiyel olarak çok düşük maliyetle gerçekten yüksek performanslı bir soğuk depolama çözümü oluşturabilirsiniz” dedi.

Veri Merkezi esnekliğini uç noktaya almak

Frankovsky tasarımlar o kadar esnek istiyor ki, bireysel bileşenler değişen talebe yanıt olarak değiştirilebilir. Bu çizgi boyunca bir çaba, Facebook’un çok sayıda satıcının işlemcilerini barındırabilecek anakartlar için yeni “Grup Hug” spesifikasyonudur. AMD ve Intel, Micro ve Calxeda’yı Uygulamalı Arm Cip Satıcılar, bu panoları yeni SOC (Chip üzerinde Sistem) ürünleriyle destekleme sözü verdiler.

Bu, geçen ayın Santa Clara, CA’daki açık hesaplama zirvesinden çıkan birkaç haberden biriydi. Toplamda, duyurular, müşterilerin “anakartları veya raf içi ağları değiştirmek zorunda kalmadan birden fazla nesil işlemci aracılığıyla yükseltebilecekleri bir geleceğe işaret ediyor,” diye açıkladı Frankovsky bir blog yazısında kaydetti.

Calxeda, Facebook’un açık kasa depolama sistemine girebilen kol tabanlı bir sunucu panosu buldu ve “Knox.”” Depolama aygıtını bir depolama sunucusuna dönüştürür ve sabit sürücüyü kontrol etmek için ayrı bir sunucu ihtiyacını ortadan kaldırır, “dedi Frankovsky. (Facebook bugün kol sunucularını kullanmıyor çünkü 64 bit destek gerektiriyor, ancak Frankovsky kol teknolojisinde “işler ilginç oluyor” diyor.)

Intel ayrıca, Facebook’un bugün veri merkezlerinde kullandığı Ethernet bağlantılarından 10 kat daha hızlı 100 gbps ara bağlantılara izin verecek bir silikon fotonik teknolojisi için tasarımlara katkıda bulundu. Bu tür bir hızla etkinleştirilen düşük gecikme ile müşteriler, CPU’ları, DRAM’ı ve depolamayı rafın farklı kısımlarına ayırabilir ve gerektiğinde tüm sunucular yerine bileşenler ekleyebilir veya çıkarabilir, dedi Frankovsky. Bu senaryoda, birden çok ana bilgisayar bir flaş sistemini paylaşabilir ve verimliliği artırabilir.

OEM dünyasının dışından gelen tüm bu özel tasarımlara rağmen, HP ve Dell tamamen geride kalmıyor. Açık hesaplama tasarımlarının esnekliğini isteyen bazı müşterileri yakalamaya çalışmak için adapte ettiler. Bir Dell yöneticisi, bu yılki açık hesaplama zirvesinde anahtar notlardan birini teslim etti ve geçen yıl hem HP hem de Dell, Open Compute Project’in “Açık Raf” spesifikasyonuyla uyumlu “temiz sayfa sunucusu ve depolama tasarımlarını” duyurdu.

Facebook için iyi olmanın yanı sıra, Frankovsky Open Compute’un genel olarak sunucu müşterilerine fayda sağlayacağını umuyor. Fidelity ve Goldman Sachs, açık hesaplama sonucunda iş yüklerine ayarlanmış özel tasarımlar kullananlar arasında. Daha küçük müşteriler, sunucuyu veya raf tasarımını değiştiremedikleri bir veri merkezinden alan kiralasalar bile, fayda sağlayabilir, dedi. Frankovsky, “[Açık Hesaplama] yapı taşlarını alıp bunları sunucu yuvalarına uyan fiziksel tasarımlara yeniden yapılandırabilirler” dedi.

“Endüstri, açık hesaplama nedeniyle tüketiciler lehine iyi bir şekilde değişiyor ve değişiyor” dedi.